احراز هویت پولی توییتر و هوش مصنوعی، ترکیبی خطرناک: انتشار اخبار انفجار جعلی در پنتاگون

دردسرهای جدید سیستم احراز هویت پولی توییتر و هوش مصنوعی: اخبار جعلی انفجار پنتاگون اینترنت را بهم ریخت.

مایه تعجب هیچکس نیست که ترکیب و تعامل قابلیت احراز هویت پولی در پلتفرم توییتر و هوش مصنوعی زایا، با انتشار اخبار جعلی نتایجی فاجعهبار بهدنبال خواهد داشت.

به گزارش واحد ترجمه ایران دکونومی، صبح روز دوشنبه اخباری مبتنی بر انفجار پنتاگون در توییتر منتشر شده بود. این تصویر جعلیِ ساخته هوش مصنوعی، نشاندهنده انفجاری عظیم در پنتاگون بود و به سرعت در اینترنت دستبهدست شد؛ درحالیکه این اتفاق هرگز واقعیت نداشته است.

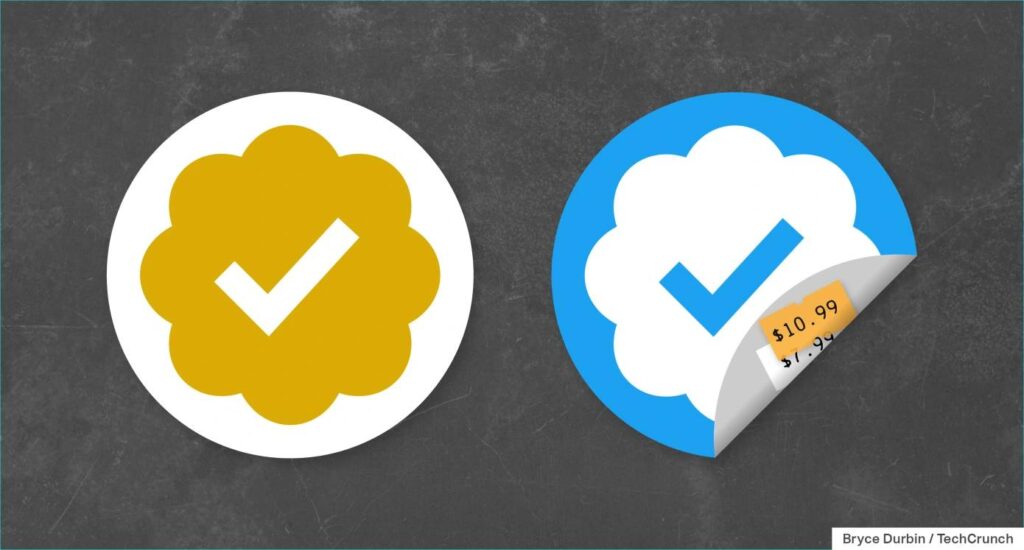

در مدت زمان نیمساعت پس از انتشار این اخبار جعلی، تصویر ذکر شده در صفحهای بهنام Bloomberg Feed، که به سادگی قابل اشتباه شدن با اکانت اصلی روزنامه Bloomberg است، مجدداً منتشر شده بود. این اکانت دارای تیک آبی احراز هویت توییتر بود و به همین دلیل امکان اشتباه گرفتن آن با اکانت اصلی Bloomberg توسط کاربران حتی بیشتر هم میشد. از زمان انتشار اخبار جعلی انفجار، این اکانت توسط توییتر تعلیق شده است.

شبکه خبری تحت نظارت و هدایت دولت روسیه به نام RT نیز بهسرعت این اخبار جعلی را بازنشر داده و تصویر ساخته هوش مصنوعی را در اکانت خود منتشر کرده بود. شواهد این موضوع بر اساس اسکرینشاتهای تهیه شده توسط کاربران، قبل از حذف توییت مربوطه توسط این شبکه خبری است.

تعداد زیادی حسابکاربری توییتر مانند اکانتهای DeItaone، OSINTdefender و Whale Chart که دارای صدها و هزاران دنبالکننده هستند نیز، این اخبار جعلی را بازنشر کرده بودند.

حتی یک رسانه تلویزیونی هندی اخبار جعلی مربوط به این انفجار را گزارش کرده بود. هنوز مشخص نیست که منبع اصلی و نقطه آغاز این تصویر و خبر ساختگی دقیقاً کجاست.

احراز هویت پولی توییتر و هوش مصنوعی زایا، ترکیبی خطرناک

اندی کمبل، روزنامهنگار و خبرنگار با انتشار توییتی نوشت: “نمونهای بارز از خطرات ناشی از سیستم احراز هویت پولی پلتفرم توییتر: این اکانت تصویری ساخته شده توسط هوش مصنوعی درباره اخبار جعلی انفجار در پنتاگون را بازنشر کرده بود. در نگاه اول، با توجه به نام و تیک آبی آن، بهنظر میرسد که این حساب کاربری در توییتر متعلق به روزنامه Bloomberg است، درحالیکه چنین چیزی صحت ندارد.”

این اولین باری نیست که انتشار تصویری جعلی و ساخته هوش مصنوعی اینترنت را بهم میریزد. اما وقتی بحث انفجار جعلی در ساختمان مرکزی و دولتی ایالات متحده و مسائل امنیتی در میان باشد، اوضاع با انتشار عکس جعلی پاپ فرانسیس درحالیکه کاپشن برند بالنسیا را به تن دارد، بسیار متفاوت است.

زمزمههایی درباره منبع اصلی تولید و نشر این تصویر به گوش میخورد، اما اثبات آن کار بسیار سختی است. همچنین وقوع این اتفاق باعث شده که عدهای نگران ضرر و زیانهای احتمالی ناشی از استفاده نادرست از هوش مصنوعی بر بازار سهام شوند.

نشر اکاذیب و اخبار جعلی، قدمتی به اندازه خود اینترنت دارد. اما رشد و پیشرفت روزافزون هوش مصنوعی زایا و سیستم احراز هویت پولی پلتفرم توییتر، بستری بسیار مناسب را برای انتشار چنین اخباری مهیا کرده است.

از همان ابتدا، اقدامات مالک کمپانی توییتر، ایلان ماسک، برای اعطای تیک آبی احراز هویت به هر کاربری در ازای مبلغی ماهانه، چیزی بهجز دردسر به همراه نداشته است. باید منتظر ماند و دید که آیا مدیرعامل جدید توییتر، لیندا یاکارینو قادر به جبران تبعات حاصل از تصمیمات جنجالی و خودسرانه ایلان ماسک خواهد بود یا خیر.

حتی اگر با این واقعیت جدید کنار بیاییم که تیکهای آبی دیگر اعتبار گذشته را ندارند و لزوماً به معنای قابل اطمینان بودن آن منبع نیستند، کنار گذاشتن عادتی تقریباً 15 ساله کار بسیار سختی است. اگر کاربران شاهد انتشار یا بازنشر خبری مانند وقوع یک انفجار سهمگین در ساختمان پنتاگون در اکانتی با نام Bloomberg Feed که از قضا دارای تیک آبی نیز هست، باشند، احتمال این که صحت و سقم این اخبار را باور کرده و بپذیرند بسیار بالاست.

تشخیص تصاویر جعلی و ساخته هوش مصنوعی از تصاویر واقعی روزبهروز سختتر میشود و بهنظر میآید که در آینده باز هم شاهد اتفاق چنین وقایع ناگواری باشیم.

منبع: Techcrunch